상품 정보

상품 기본설명

강화학습 기본 개념을 제대로 정리한 인공지능 교과서

상품 상세설명

내용을 대폭 보강하여 20년 만에 개정된 강화학습 분야의 절대 바이블!

인공지능 분야에서 가장 활발하게 연구되고 있는 분야 중 하나인 강화학습은 복잡하고 불확실한 환경과 상호작용하는 학습자에게 주어지는 보상을 최대화하는 수치 계산적 학습 방법이다. 리처드 서튼과 앤드류 바르토는 이 책 《단단한 강화학습》을 통해 강화학습의 핵심적인 개념과 알고리즘을 분명하고 이해하기 쉽게 설명한다. 1판이 출간된 이후 새롭게 부각된 주제들을 추가하였고, 이미 다루었던 주제들도 최신 내용으로 업데이트하였다.

인공지능 분야에서 가장 활발하게 연구되고 있는 분야 중 하나인 강화학습은 복잡하고 불확실한 환경과 상호작용하는 학습자에게 주어지는 보상을 최대화하는 수치 계산적 학습 방법이다. 리처드 서튼과 앤드류 바르토는 이 책 《단단한 강화학습》을 통해 강화학습의 핵심적인 개념과 알고리즘을 분명하고 이해하기 쉽게 설명한다. 1판이 출간된 이후 새롭게 부각된 주제들을 추가하였고, 이미 다루었던 주제들도 최신 내용으로 업데이트하였다.

목차

CHAPTER 01 소개 1

1.1 강화학습 2

1.2 예제 5

1.3 강화학습의 구성 요소 7

1.4 한계와 범위 9

1.5 확장된 예제: 틱택토 10

1.6 요약 16

1.7 강화학습의 초기 역사 17

참고문헌 27

PART I 표 형태의 해법

CHAPTER 02 다중 선택 31

2.1 다중 선택 문제 32

2.2 행동 가치 방법 34

2.3 10중 선택 테스트 35

2.4 점증적 구현 38

2.5 비정상 문제의 흔적 40

2.6 긍정적 초깃값 42

2.7 신뢰 상한 행동 선택 44

2.8 경사도 다중 선택 알고리즘 46

2.9 연관 탐색(맥락적 다중 선택) 50

2.10 요약 51

참고문헌 및 역사적 사실 54

CHAPTER 03 유한 마르코프 결정 과정 57

3.1 에이전트-환경 인터페이스 58

3.2 목표와 보상 64

3.3 보상과 에피소드 66

3.4 에피소딕 작업과 연속적인 작업을 위한 통합 표기법 69

3.5 정책과 가치 함수 70

3.6 최적 정책과 최적 가치 함수 76

3.7 최적성과 근사 82

3.8 요약 83

참고문헌 및 역사적 사실 84

CHAPTER 04 동적 프로그래밍 89

4.1 정책 평가(예측) 90

4.2 정책 향상 94

4.3 정책 반복 97

4.4 가치 반복 100

4.5 비동기 동적 프로그래밍 103

4.6 일반화된 정책 반복 104

4.7 동적 프로그래밍의 효율성 106

4.8 요약 107

참고문헌 및 역사적 사실 109

CHAPTER 05 몬테카를로 방법 111

5.1 몬테카를로 예측 112

5.2 몬테카를로 행동 가치 추정 118

5.3 몬테카를로 제어 119

5.4 시작 탐험 없는 몬테카를로 제어 123

5.5 중요도추출법을 통한 비활성 정책 예측 126

5.6 점증적 구현 133

5.7 비활성 몬테카를로 제어 135

5.8 할인을 고려한 중요도추출법 138

5.9 결정 단계별 중요도추출법 139

5.10 요약 141

참고문헌 및 역사적 사실 143

CHAPTER 06 시간차 학습 145

6.1 TD 예측 146

6.2 TD 예측 방법의 좋은점 150

6.3 TD(0)의 최적성 153

6.4 살사: 활성 정책 TD 제어 157

6.5 Q 학습: 비활성 정책 TD 제어 160

6.6 기댓값 살사 162

6.7 최대화 편차 및 이중 학습 163

6.8 게임, 이후상태, 그 밖의 특별한 경우들 166

6.9 요약 168

참고문헌 및 역사적 사실 169

CHAPTER 07 n단계 부트스트랩 171

7.1 n단계 TD 예측 172

7.2 n단계 살사 177

7.3 n단계 비활성 정책 학습 179

7.4 제어 변수가 있는 결정 단계별 방법 181

7.5 중요도추출법을 사용하지 않는 비활성 정책 학습: n단계 트리 보강 알고리즘 184

7.6 통합 알고리즘: n단계 Q(σ) 187

7.7 요약 189

참고문헌 및 역사적 사실 190

CHAPTER 08 표에 기반한 방법을 이용한 계획 및 학습 191

8.1 모델과 계획 192

8.2 다이나: 계획, 행동, 학습의 통합 194

8.3 모델이 틀렸을 때 199

8.4 우선순위가 있는 일괄처리 202

8.5 기댓값 갱신 대 표본 갱신 206

8.6 궤적 표본추출 210

8.7 실시간 동적 프로그래밍 213

8.8 결정 시점에서의 계획 217

8.9 경험적 탐색 219

8.10 주사위 던지기 알고리즘 221

8.11 몬테카를로 트리 탐색 223

8.12 요약 227

8.13 1부 요약: 차원 228

참고문헌 및 역사적 사실 231

PART II 근사적 해법

CHAPTER 09 근사를 이용한 활성 정책 예측 237

9.1 가치 함수 근사 238

9.2 예측 목적(VE) 239

9.3 확률론적 경사도와 준경사도 방법 241

9.4 선형 방법 246

9.5 선형 방법을 위한 특징 만들기 253

9.6 시간 간격 파라미터를 수동으로 선택하기 268

9.7 비선형 함수 근사: 인공 신경망 269

9.8 최소 제곱 TD 275

9.9 메모리 기반 함수 근사 278

9.10 커널 기반 함수 근사 280

9.11 활성 정책 학습에 대한 보다 깊은 관찰: 관심과 강조 282

9.12 요약 285

참고문헌 및 역사적 사실 286

CHAPTER 10 근사를 적용한 활성 정책 제어 293

10.1 에피소딕 준경사도 제어 294

10.2 준경사도 n단계 살사 297

10.3 평균 보상: 연속적 작업을 위한 새로운 문제 설정 300

10.4 할인된 설정에 대한 반대 304

10.5 미분 준경사도 n단계 살사 307

10.6 요약 308

참고문헌 및 역사적 사실 308

CHAPTER 11 근사를 활용한 비활성 정책 방법 311

11.1 준경사도 방법 312

11.2 비활성 정책 발산의 예제 315

11.3 치명적인 삼위일체 320

11.4 선형 가치 함수 기하 구조 322

11.5 벨만 오차에서의 경사도 강하 327

11.6 벨만 오차는 학습할 수 없다 332

11.7 경사도 TD 방법 337

11.8 강한 TD 방법 341

11.9 분산 줄이기 343

11.10 요약 345

참고문헌 및 역사적 사실 346

CHAPTER 12 적격 흔적 349

12.1 λ 이득 350

12.2 TD(λ) 355

12.3 중단된 n단계 λ 이득 방법 359

12.4 다시 갱신하기: 온라인 λ 이득 알고리즘 361

12.5 진정한 온라인 TD(λ) 363

12.6 몬테카를로 학습에서의 더치 흔적 366

12.7 살사(λ) 368

12.8 가변 λ 및 γ 372

12.9 제어 변수가 있는 비활성 정책 흔적 374

12.10 왓킨스의 Q(λ)에서 트리 보강(λ)로 378

12.11 흔적을 이용한 안정적인 비활성 정책 방법 381

12.12 구현 이슈 383

12.13 결론 384

참고문헌 및 역사적 사실 386

CHAPTER 13 정책 경사도 방법 389

13.1 정책 근사 및 정책 근사의 장점 390

13.2 정책 경사도 정리 393

13.3 REINFORCE: 몬테카를로 정책 경사도 395

13.4 기준값이 있는 REINFORCE 399

13.5 행동자-비평자 방법 401

13.6 연속적인 문제에 대한 정책 경사도 403

13.7 연속적 행동을 위한 정책 파라미터화 406

13.8 요약 408

참고문헌 및 역사적 사실 409

PART III 더 깊이 들여다보기

CHAPTER 14 심리학 413

14.1 예측과 제어 414

14.2 고전적 조건화 416

14.3 도구적 조건화 433

14.4 지연된 강화 438

14.5 인지 지도 440

14.6 습관적 행동과 목표 지향적 행동 442

14.7 요약 447

참고문헌 및 역사적 사실 449

CHAPTER 15 신경과학 457

15.1 신경과학 기본 458

15.2 보상 신호, 강화 신호, 가치, 예측 오차 460

15.3 보상 예측 오차 가설 463

15.4 도파민 465

15.5 보상 예측 오차 가설에 대한 실험적 근거 469

15.6 TD 오차/도파민 유사성 473

15.7 신경 행동자-비평자 479

15.8 행동자와 비평자 학습 규칙 482

15.9 쾌락주의 뉴런 488

15.10 집단적 강화학습 490

15.11 뇌에서의 모델 기반 방법 494

15.12 중독 496

15.13 요약 497

참고문헌 및 역사적 사실 501

CHAPTER 16 적용 및 사례 연구 511

16.1 TD-가몬 511

16.2 사무엘의 체커 선수 518

16.3 왓슨의 이중 내기 522

16.4 메모리 제어 최적화 526

16.5 인간 수준의 비디오 게임 실력 531

16.6 바둑 게임에 통달하다 539

16.7 개인화된 웹 서비스 550

16.8 열 상승 554

CHAPTER 17 프론티어 559

17.1 일반적인 가치 함수 및 보조 작업 559

17.2 옵션을 통한 시간적 추상화 562

17.3 관측과 상태 565

17.4 보상 신호의 설계 572

17.5 남아 있는 이슈들 576

17.6 인공지능의 미래 580

참고문헌 및 역사적 사실 584

참고문헌 588

찾아보기 626

1.1 강화학습 2

1.2 예제 5

1.3 강화학습의 구성 요소 7

1.4 한계와 범위 9

1.5 확장된 예제: 틱택토 10

1.6 요약 16

1.7 강화학습의 초기 역사 17

참고문헌 27

PART I 표 형태의 해법

CHAPTER 02 다중 선택 31

2.1 다중 선택 문제 32

2.2 행동 가치 방법 34

2.3 10중 선택 테스트 35

2.4 점증적 구현 38

2.5 비정상 문제의 흔적 40

2.6 긍정적 초깃값 42

2.7 신뢰 상한 행동 선택 44

2.8 경사도 다중 선택 알고리즘 46

2.9 연관 탐색(맥락적 다중 선택) 50

2.10 요약 51

참고문헌 및 역사적 사실 54

CHAPTER 03 유한 마르코프 결정 과정 57

3.1 에이전트-환경 인터페이스 58

3.2 목표와 보상 64

3.3 보상과 에피소드 66

3.4 에피소딕 작업과 연속적인 작업을 위한 통합 표기법 69

3.5 정책과 가치 함수 70

3.6 최적 정책과 최적 가치 함수 76

3.7 최적성과 근사 82

3.8 요약 83

참고문헌 및 역사적 사실 84

CHAPTER 04 동적 프로그래밍 89

4.1 정책 평가(예측) 90

4.2 정책 향상 94

4.3 정책 반복 97

4.4 가치 반복 100

4.5 비동기 동적 프로그래밍 103

4.6 일반화된 정책 반복 104

4.7 동적 프로그래밍의 효율성 106

4.8 요약 107

참고문헌 및 역사적 사실 109

CHAPTER 05 몬테카를로 방법 111

5.1 몬테카를로 예측 112

5.2 몬테카를로 행동 가치 추정 118

5.3 몬테카를로 제어 119

5.4 시작 탐험 없는 몬테카를로 제어 123

5.5 중요도추출법을 통한 비활성 정책 예측 126

5.6 점증적 구현 133

5.7 비활성 몬테카를로 제어 135

5.8 할인을 고려한 중요도추출법 138

5.9 결정 단계별 중요도추출법 139

5.10 요약 141

참고문헌 및 역사적 사실 143

CHAPTER 06 시간차 학습 145

6.1 TD 예측 146

6.2 TD 예측 방법의 좋은점 150

6.3 TD(0)의 최적성 153

6.4 살사: 활성 정책 TD 제어 157

6.5 Q 학습: 비활성 정책 TD 제어 160

6.6 기댓값 살사 162

6.7 최대화 편차 및 이중 학습 163

6.8 게임, 이후상태, 그 밖의 특별한 경우들 166

6.9 요약 168

참고문헌 및 역사적 사실 169

CHAPTER 07 n단계 부트스트랩 171

7.1 n단계 TD 예측 172

7.2 n단계 살사 177

7.3 n단계 비활성 정책 학습 179

7.4 제어 변수가 있는 결정 단계별 방법 181

7.5 중요도추출법을 사용하지 않는 비활성 정책 학습: n단계 트리 보강 알고리즘 184

7.6 통합 알고리즘: n단계 Q(σ) 187

7.7 요약 189

참고문헌 및 역사적 사실 190

CHAPTER 08 표에 기반한 방법을 이용한 계획 및 학습 191

8.1 모델과 계획 192

8.2 다이나: 계획, 행동, 학습의 통합 194

8.3 모델이 틀렸을 때 199

8.4 우선순위가 있는 일괄처리 202

8.5 기댓값 갱신 대 표본 갱신 206

8.6 궤적 표본추출 210

8.7 실시간 동적 프로그래밍 213

8.8 결정 시점에서의 계획 217

8.9 경험적 탐색 219

8.10 주사위 던지기 알고리즘 221

8.11 몬테카를로 트리 탐색 223

8.12 요약 227

8.13 1부 요약: 차원 228

참고문헌 및 역사적 사실 231

PART II 근사적 해법

CHAPTER 09 근사를 이용한 활성 정책 예측 237

9.1 가치 함수 근사 238

9.2 예측 목적(VE) 239

9.3 확률론적 경사도와 준경사도 방법 241

9.4 선형 방법 246

9.5 선형 방법을 위한 특징 만들기 253

9.6 시간 간격 파라미터를 수동으로 선택하기 268

9.7 비선형 함수 근사: 인공 신경망 269

9.8 최소 제곱 TD 275

9.9 메모리 기반 함수 근사 278

9.10 커널 기반 함수 근사 280

9.11 활성 정책 학습에 대한 보다 깊은 관찰: 관심과 강조 282

9.12 요약 285

참고문헌 및 역사적 사실 286

CHAPTER 10 근사를 적용한 활성 정책 제어 293

10.1 에피소딕 준경사도 제어 294

10.2 준경사도 n단계 살사 297

10.3 평균 보상: 연속적 작업을 위한 새로운 문제 설정 300

10.4 할인된 설정에 대한 반대 304

10.5 미분 준경사도 n단계 살사 307

10.6 요약 308

참고문헌 및 역사적 사실 308

CHAPTER 11 근사를 활용한 비활성 정책 방법 311

11.1 준경사도 방법 312

11.2 비활성 정책 발산의 예제 315

11.3 치명적인 삼위일체 320

11.4 선형 가치 함수 기하 구조 322

11.5 벨만 오차에서의 경사도 강하 327

11.6 벨만 오차는 학습할 수 없다 332

11.7 경사도 TD 방법 337

11.8 강한 TD 방법 341

11.9 분산 줄이기 343

11.10 요약 345

참고문헌 및 역사적 사실 346

CHAPTER 12 적격 흔적 349

12.1 λ 이득 350

12.2 TD(λ) 355

12.3 중단된 n단계 λ 이득 방법 359

12.4 다시 갱신하기: 온라인 λ 이득 알고리즘 361

12.5 진정한 온라인 TD(λ) 363

12.6 몬테카를로 학습에서의 더치 흔적 366

12.7 살사(λ) 368

12.8 가변 λ 및 γ 372

12.9 제어 변수가 있는 비활성 정책 흔적 374

12.10 왓킨스의 Q(λ)에서 트리 보강(λ)로 378

12.11 흔적을 이용한 안정적인 비활성 정책 방법 381

12.12 구현 이슈 383

12.13 결론 384

참고문헌 및 역사적 사실 386

CHAPTER 13 정책 경사도 방법 389

13.1 정책 근사 및 정책 근사의 장점 390

13.2 정책 경사도 정리 393

13.3 REINFORCE: 몬테카를로 정책 경사도 395

13.4 기준값이 있는 REINFORCE 399

13.5 행동자-비평자 방법 401

13.6 연속적인 문제에 대한 정책 경사도 403

13.7 연속적 행동을 위한 정책 파라미터화 406

13.8 요약 408

참고문헌 및 역사적 사실 409

PART III 더 깊이 들여다보기

CHAPTER 14 심리학 413

14.1 예측과 제어 414

14.2 고전적 조건화 416

14.3 도구적 조건화 433

14.4 지연된 강화 438

14.5 인지 지도 440

14.6 습관적 행동과 목표 지향적 행동 442

14.7 요약 447

참고문헌 및 역사적 사실 449

CHAPTER 15 신경과학 457

15.1 신경과학 기본 458

15.2 보상 신호, 강화 신호, 가치, 예측 오차 460

15.3 보상 예측 오차 가설 463

15.4 도파민 465

15.5 보상 예측 오차 가설에 대한 실험적 근거 469

15.6 TD 오차/도파민 유사성 473

15.7 신경 행동자-비평자 479

15.8 행동자와 비평자 학습 규칙 482

15.9 쾌락주의 뉴런 488

15.10 집단적 강화학습 490

15.11 뇌에서의 모델 기반 방법 494

15.12 중독 496

15.13 요약 497

참고문헌 및 역사적 사실 501

CHAPTER 16 적용 및 사례 연구 511

16.1 TD-가몬 511

16.2 사무엘의 체커 선수 518

16.3 왓슨의 이중 내기 522

16.4 메모리 제어 최적화 526

16.5 인간 수준의 비디오 게임 실력 531

16.6 바둑 게임에 통달하다 539

16.7 개인화된 웹 서비스 550

16.8 열 상승 554

CHAPTER 17 프론티어 559

17.1 일반적인 가치 함수 및 보조 작업 559

17.2 옵션을 통한 시간적 추상화 562

17.3 관측과 상태 565

17.4 보상 신호의 설계 572

17.5 남아 있는 이슈들 576

17.6 인공지능의 미래 580

참고문헌 및 역사적 사실 584

참고문헌 588

찾아보기 626

책속으로

이 책이 처음 출간된 1998년 이후로 20년 동안 인공지능 기술은 엄청나게 발전했다. 강화학습을 비롯한 기계학습 기술의 발전은 인공지능의 발전에 큰 동력을 제공해 주었다. 기계학습 기술의 발전에는 컴퓨터의 계산 능력이 눈부시게 향상된 것이 한몫을 했지만, 새로운 이론과 알고리즘의 개발 또한 중요한 역할을 했다. 이러한 변화가 있었음에도 이 책의 2판 작업이 오랜 시간 지체되어 2012년이 되어서야 작업을 시작할 수 있었다. 2판의 목적은 이 책을 처음 출간했을 때와 다르지 않다. 즉, 관련된 모든 분야의 독자들이 강화학습의 핵심 개념과 알고리즘을 쉽고 명료하게 이해할 수 있도록 하는 것이다.

_xviii페이지(머리말 중에서)다음과 같은 학습 문제를 생각해 보자. k개의 서로 다른 옵션이나 행동 중 하나를 반복적으로 선택해야 한다. 매 선택 후에는 숫자로 된 보상이 주어진다. 이때 보상을 나타내는 값은 선택된 행동에 따라 결정되는 정상 확률 분포(stationary probability distribution, 시간에 따라 변하지 않는 확률 분포_옮긴이)로부터 얻어진다. 선택의 목적은 일정 기간, 예를 들면 행동을 1,000번 선택하는 기간 또는 1,000개의 시간 간격(time step) 동안 주어지는 보상의 총량에 대한 기댓값을 최대화하는 것이다.

_32페이지또 다른 합리적인 답변은 상태 A를 한 번 마주쳤고 그에 따른 이득이 0이어서 V(A)의 값을 0으로 추정했다는 사실을 단순히 관찰하는 것이다. 이 답변은 일괄 몬테카를로 방법이 주는 답변이다. 이것이 훈련 데이터에 대한 최소 제곱 오차를 도출하는 답변이라는 점에 주목하라. 사실, 이 답변은 훈련 데이터에 대해 0의 오차를 도출한다.

_155페이지과다 적합은 제한된 훈련 데이터에 기반하여 많은 자유도를 갖고 함수를 조정하는 모든 함수 근사 방법에서 문제가 된다. 제한된 훈련 데이터에 구속받지 않는 온라인 강화학습에서는 이러한 문제가 덜하지만, 효과적으로 일반화하는 것은 여전히 중요한 이슈다. 과다 적합은 일반적으로 ANN이 갖는 문제이지만, 아주 많은 수의 가중치를 갖는 경향성 때문에 심층 ANN의 경우에는 더 심각한 문제가 된다.

_272페이지레스콜라-바그너 모델 같은 시행 단계 모델과는 반대로, TD 모델은 실시간real-time 모델이다. 레스콜라-바그너 모델에서 단일 단계 t는 전체 조건화 시도를 나타낸다. TD 모델은 조건화 시도가 발생하는 시간 도중에 어떤 일이 일어나는지 또는 조건화 시도 사이에 무엇이 발생하는지에 관한 자세한 사항들에 신경 쓰지 않는다. 각각의 조건화 시도 과정 중에 동물은 특정한 시각에 특정한 기간 동안 발생하는 다양한 자극을 경험할 수도 있다.

_423페이지

_xviii페이지(머리말 중에서)다음과 같은 학습 문제를 생각해 보자. k개의 서로 다른 옵션이나 행동 중 하나를 반복적으로 선택해야 한다. 매 선택 후에는 숫자로 된 보상이 주어진다. 이때 보상을 나타내는 값은 선택된 행동에 따라 결정되는 정상 확률 분포(stationary probability distribution, 시간에 따라 변하지 않는 확률 분포_옮긴이)로부터 얻어진다. 선택의 목적은 일정 기간, 예를 들면 행동을 1,000번 선택하는 기간 또는 1,000개의 시간 간격(time step) 동안 주어지는 보상의 총량에 대한 기댓값을 최대화하는 것이다.

_32페이지또 다른 합리적인 답변은 상태 A를 한 번 마주쳤고 그에 따른 이득이 0이어서 V(A)의 값을 0으로 추정했다는 사실을 단순히 관찰하는 것이다. 이 답변은 일괄 몬테카를로 방법이 주는 답변이다. 이것이 훈련 데이터에 대한 최소 제곱 오차를 도출하는 답변이라는 점에 주목하라. 사실, 이 답변은 훈련 데이터에 대해 0의 오차를 도출한다.

_155페이지과다 적합은 제한된 훈련 데이터에 기반하여 많은 자유도를 갖고 함수를 조정하는 모든 함수 근사 방법에서 문제가 된다. 제한된 훈련 데이터에 구속받지 않는 온라인 강화학습에서는 이러한 문제가 덜하지만, 효과적으로 일반화하는 것은 여전히 중요한 이슈다. 과다 적합은 일반적으로 ANN이 갖는 문제이지만, 아주 많은 수의 가중치를 갖는 경향성 때문에 심층 ANN의 경우에는 더 심각한 문제가 된다.

_272페이지레스콜라-바그너 모델 같은 시행 단계 모델과는 반대로, TD 모델은 실시간real-time 모델이다. 레스콜라-바그너 모델에서 단일 단계 t는 전체 조건화 시도를 나타낸다. TD 모델은 조건화 시도가 발생하는 시간 도중에 어떤 일이 일어나는지 또는 조건화 시도 사이에 무엇이 발생하는지에 관한 자세한 사항들에 신경 쓰지 않는다. 각각의 조건화 시도 과정 중에 동물은 특정한 시각에 특정한 기간 동안 발생하는 다양한 자극을 경험할 수도 있다.

_423페이지

출판사 서평

내용을 대폭 보강하여 20년 만에 개정된 강화학습 분야의 절대 바이블!

강화학습의 핵심 개념과 최신 알고리즘을 쉽고 명료하게 이해한다!인공지능 분야에서 가장 활발하게 연구되고 있는 분야 중 하나인 강화학습은 복잡하고 불확실한 환경과 상호작용하는 학습자에게 주어지는 보상을 최대화하는 수치 계산적 학습 방법이다. 리처드 서튼과 앤드류 바르토는 이 책 《단단한 강화학습》을 통해 강화학습의 핵심적인 개념과 알고리즘을 분명하고 이해하기 쉽게 설명한다. 1판이 출간된 이후 새롭게 부각된 주제들을 추가하였고, 이미 다루었던 주제들도 최신 내용으로 업데이트하였다.1판과 마찬가지로 2판에서도 핵심적인 온라인 학습 알고리즘을 집중적으로 다루었는데, 보다 많은 수학적 내용을 별도의 글 상자 안에 추가하였다. 이 책은 크게 다음과 같은 세 부분으로 나누어진다.■ 첫 번째 부분에서는 정확한 해법을 찾을 수 있는 표 기반 방법만을 적용하여 가능한 한 많은 강화학습 방법을 다루었다. 첫 번째 부분에 제시되는 많은 알고리즘은 2판에서 새롭게 추가된 것인데, 여기에는 UCB, 기댓값 살사, 이중 학습이 포함된다.

■ 두 번째 부분에서는 인공 신경망이나 푸리에 기반과 같은 주제를 다루는 절이 새롭게 추가되면서 첫 번째 부분에서 제시된 방법들이 함수 근사 기반의 방법으로 확장되었고, 비활성 정책 학습과 정책 경사도 방법에 대한 내용이 더욱 풍부해졌다.

■ 세 번째 부분에서는 강화학습이 심리학 및 신경 과학과 어떤 관계인지를 다루는 새로운 장들이 추가되었고, 알파고와 알파고 제로, 아타리 게임, IBM 왓슨의 내기 전략과 같은 사례 연구를 다루는 장이 업데이트되었다. 마지막 장에서는 강화학습이 미래 사회에 미칠 영향에 대해 논의하였다.

강화학습의 핵심 개념과 최신 알고리즘을 쉽고 명료하게 이해한다!인공지능 분야에서 가장 활발하게 연구되고 있는 분야 중 하나인 강화학습은 복잡하고 불확실한 환경과 상호작용하는 학습자에게 주어지는 보상을 최대화하는 수치 계산적 학습 방법이다. 리처드 서튼과 앤드류 바르토는 이 책 《단단한 강화학습》을 통해 강화학습의 핵심적인 개념과 알고리즘을 분명하고 이해하기 쉽게 설명한다. 1판이 출간된 이후 새롭게 부각된 주제들을 추가하였고, 이미 다루었던 주제들도 최신 내용으로 업데이트하였다.1판과 마찬가지로 2판에서도 핵심적인 온라인 학습 알고리즘을 집중적으로 다루었는데, 보다 많은 수학적 내용을 별도의 글 상자 안에 추가하였다. 이 책은 크게 다음과 같은 세 부분으로 나누어진다.■ 첫 번째 부분에서는 정확한 해법을 찾을 수 있는 표 기반 방법만을 적용하여 가능한 한 많은 강화학습 방법을 다루었다. 첫 번째 부분에 제시되는 많은 알고리즘은 2판에서 새롭게 추가된 것인데, 여기에는 UCB, 기댓값 살사, 이중 학습이 포함된다.

■ 두 번째 부분에서는 인공 신경망이나 푸리에 기반과 같은 주제를 다루는 절이 새롭게 추가되면서 첫 번째 부분에서 제시된 방법들이 함수 근사 기반의 방법으로 확장되었고, 비활성 정책 학습과 정책 경사도 방법에 대한 내용이 더욱 풍부해졌다.

■ 세 번째 부분에서는 강화학습이 심리학 및 신경 과학과 어떤 관계인지를 다루는 새로운 장들이 추가되었고, 알파고와 알파고 제로, 아타리 게임, IBM 왓슨의 내기 전략과 같은 사례 연구를 다루는 장이 업데이트되었다. 마지막 장에서는 강화학습이 미래 사회에 미칠 영향에 대해 논의하였다.

상품 정보 고시

| 도서명 | 단단한 강화학습 |

|---|---|

| 저자 | 리처드 서튼 , 앤드류 바르토 |

| 출판사 | 제이펍 |

| ISBN | 9791190665179 (1190665174) |

| 쪽수 | 664 |

| 출간일 | 2020-03-31 |

| 사이즈 | 191 * 247 * 35 mm /1289g |

| 목차 또는 책소개 | CHAPTER 01 소개 1 1.1 강화학습 2 1.2 예제 5 1.3 강화학습의 구성 요소 7 1.4 한계와 범위 9 1.5 확장된 예제: 틱택토 10 1.6 요약 16 1.7 강화학습의 초기 역사 17 참고문헌 27 PART I 표 형태의 해법 CHAPTER 02 다중 선택 31 2.1 다중 선택 문제 32 2.2 행동 가치 방법 34 2.3 10중 선택 테스트 35 2.4 점증적 구현 38 2.5 비정상 문제의 흔적 40 2.6 긍정적 초깃값 42 2.7 신뢰 상한 행동 선택 44 2.8 경사도 다중 선택 알고리즘 46 2.9 연관 탐색(맥락적 다중 선택) 50 2.10 요약 51 참고문헌 및 역사적 사실 54 CHAPTER 03 유한 마르코프 결정 과정 57 3.1 에이전트-환경 인터페이스 58 3.2 목표와 보상 64 3.3 보상과 에피소드 66 3.4 에피소딕 작업과 연속적인 작업을 위한 통합 표기법 69 3.5 정책과 가치 함수 70 3.6 최적 정책과 최적 가치 함수 76 3.7 최적성과 근사 82 3.8 요약 83 참고문헌 및 역사적 사실 84 CHAPTER 04 동적 프로그래밍 89 4.1 정책 평가(예측) 90 4.2 정책 향상 94 4.3 정책 반복 97 4.4 가치 반복 100 4.5 비동기 동적 프로그래밍 103 4.6 일반화된 정책 반복 104 4.7 동적 프로그래밍의 효율성 106 4.8 요약 107 참고문헌 및 역사적 사실 109 CHAPTER 05 몬테카를로 방법 111 5.1 몬테카를로 예측 112 5.2 몬테카를로 행동 가치 추정 118 5.3 몬테카를로 제어 119 5.4 시작 탐험 없는 몬테카를로 제어 123 5.5 중요도추출법을 통한 비활성 정책 예측 126 5.6 점증적 구현 133 5.7 비활성 몬테카를로 제어 135 5.8 할인을 고려한 중요도추출법 138 5.9 결정 단계별 중요도추출법 139 5.10 요약 141 참고문헌 및 역사적 사실 143 CHAPTER 06 시간차 학습 145 6.1 TD 예측 146 6.2 TD 예측 방법의 좋은점 150 6.3 TD(0)의 최적성 153 6.4 살사: 활성 정책 TD 제어 157 6.5 Q 학습: 비활성 정책 TD 제어 160 6.6 기댓값 살사 162 6.7 최대화 편차 및 이중 학습 163 6.8 게임, 이후상태, 그 밖의 특별한 경우들 166 6.9 요약 168 참고문헌 및 역사적 사실 169 CHAPTER 07 n단계 부트스트랩 171 7.1 n단계 TD 예측 172 7.2 n단계 살사 177 7.3 n단계 비활성 정책 학습 179 7.4 제어 변수가 있는 결정 단계별 방법 181 7.5 중요도추출법을 사용하지 않는 비활성 정책 학습: n단계 트리 보강 알고리즘 184 7.6 통합 알고리즘: n단계 Q(σ) 187 7.7 요약 189 참고문헌 및 역사적 사실 190 CHAPTER 08 표에 기반한 방법을 이용한 계획 및 학습 191 8.1 모델과 계획 192 8.2 다이나: 계획, 행동, 학습의 통합 194 8.3 모델이 틀렸을 때 199 8.4 우선순위가 있는 일괄처리 202 8.5 기댓값 갱신 대 표본 갱신 206 8.6 궤적 표본추출 210 8.7 실시간 동적 프로그래밍 213 8.8 결정 시점에서의 계획 217 8.9 경험적 탐색 219 8.10 주사위 던지기 알고리즘 221 8.11 몬테카를로 트리 탐색 223 8.12 요약 227 8.13 1부 요약: 차원 228 참고문헌 및 역사적 사실 231 PART II 근사적 해법 CHAPTER 09 근사를 이용한 활성 정책 예측 237 9.1 가치 함수 근사 238 9.2 예측 목적(VE) 239 9.3 확률론적 경사도와 준경사도 방법 241 9.4 선형 방법 246 9.5 선형 방법을 위한 특징 만들기 253 9.6 시간 간격 파라미터를 수동으로 선택하기 268 9.7 비선형 함수 근사: 인공 신경망 269 9.8 최소 제곱 TD 275 9.9 메모리 기반 함수 근사 278 9.10 커널 기반 함수 근사 280 9.11 활성 정책 학습에 대한 보다 깊은 관찰: 관심과 강조 282 9.12 요약 285 참고문헌 및 역사적 사실 286 CHAPTER 10 근사를 적용한 활성 정책 제어 293 10.1 에피소딕 준경사도 제어 294 10.2 준경사도 n단계 살사 297 10.3 평균 보상: 연속적 작업을 위한 새로운 문제 설정 300 10.4 할인된 설정에 대한 반대 304 10.5 미분 준경사도 n단계 살사 307 10.6 요약 308 참고문헌 및 역사적 사실 308 CHAPTER 11 근사를 활용한 비활성 정책 방법 311 11.1 준경사도 방법 312 11.2 비활성 정책 발산의 예제 315 11.3 치명적인 삼위일체 320 11.4 선형 가치 함수 기하 구조 322 11.5 벨만 오차에서의 경사도 강하 327 11.6 벨만 오차는 학습할 수 없다 332 11.7 경사도 TD 방법 337 11.8 강한 TD 방법 341 11.9 분산 줄이기 343 11.10 요약 345 참고문헌 및 역사적 사실 346 CHAPTER 12 적격 흔적 349 12.1 λ 이득 350 12.2 TD(λ) 355 12.3 중단된 n단계 λ 이득 방법 359 12.4 다시 갱신하기: 온라인 λ 이득 알고리즘 361 12.5 진정한 온라인 TD(λ) 363 12.6 몬테카를로 학습에서의 더치 흔적 366 12.7 살사(λ) 368 12.8 가변 λ 및 γ 372 12.9 제어 변수가 있는 비활성 정책 흔적 374 12.10 왓킨스의 Q(λ)에서 트리 보강(λ)로 378 12.11 흔적을 이용한 안정적인 비활성 정책 방법 381 12.12 구현 이슈 383 12.13 결론 384 참고문헌 및 역사적 사실 386 CHAPTER 13 정책 경사도 방법 389 13.1 정책 근사 및 정책 근사의 장점 390 13.2 정책 경사도 정리 393 13.3 REINFORCE: 몬테카를로 정책 경사도 395 13.4 기준값이 있는 REINFORCE 399 13.5 행동자-비평자 방법 401 13.6 연속적인 문제에 대한 정책 경사도 403 13.7 연속적 행동을 위한 정책 파라미터화 406 13.8 요약 408 참고문헌 및 역사적 사실 409 PART III 더 깊이 들여다보기 CHAPTER 14 심리학 413 14.1 예측과 제어 414 14.2 고전적 조건화 416 14.3 도구적 조건화 433 14.4 지연된 강화 438 14.5 인지 지도 440 14.6 습관적 행동과 목표 지향적 행동 442 14.7 요약 447 참고문헌 및 역사적 사실 449 CHAPTER 15 신경과학 457 15.1 신경과학 기본 458 15.2 보상 신호, 강화 신호, 가치, 예측 오차 460 15.3 보상 예측 오차 가설 463 15.4 도파민 465 15.5 보상 예측 오차 가설에 대한 실험적 근거 469 15.6 TD 오차/도파민 유사성 473 15.7 신경 행동자-비평자 479 15.8 행동자와 비평자 학습 규칙 482 15.9 쾌락주의 뉴런 488 15.10 집단적 강화학습 490 15.11 뇌에서의 모델 기반 방법 494 15.12 중독 496 15.13 요약 497 참고문헌 및 역사적 사실 501 CHAPTER 16 적용 및 사례 연구 511 16.1 TD-가몬 511 16.2 사무엘의 체커 선수 518 16.3 왓슨의 이중 내기 522 16.4 메모리 제어 최적화 526 16.5 인간 수준의 비디오 게임 실력 531 16.6 바둑 게임에 통달하다 539 16.7 개인화된 웹 서비스 550 16.8 열 상승 554 CHAPTER 17 프론티어 559 17.1 일반적인 가치 함수 및 보조 작업 559 17.2 옵션을 통한 시간적 추상화 562 17.3 관측과 상태 565 17.4 보상 신호의 설계 572 17.5 남아 있는 이슈들 576 17.6 인공지능의 미래 580 참고문헌 및 역사적 사실 584 참고문헌 588 찾아보기 626 |

사용후기

회원리뷰 총 0개

사용후기가 없습니다.

상품문의

등록된 상품문의

상품문의 총 0개

상품문의가 없습니다.

교환/반품

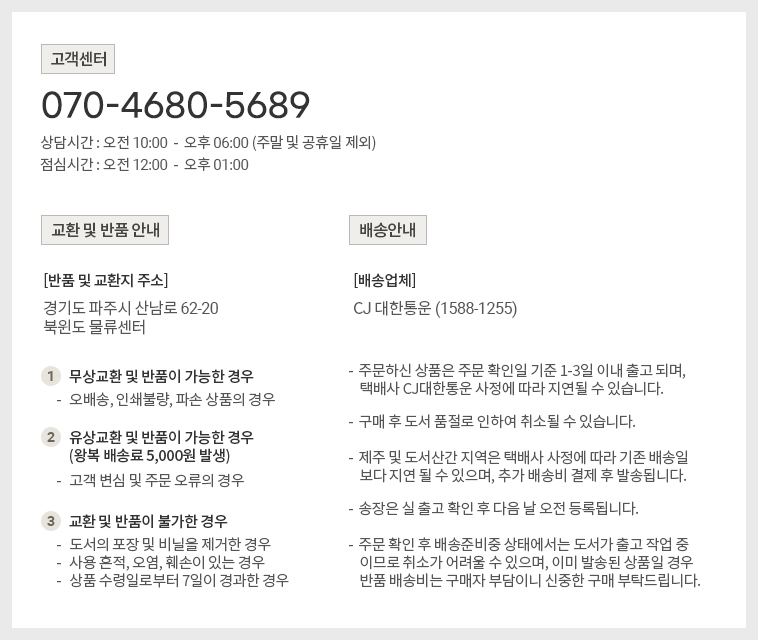

[반품/교환방법]

마이페이지> 주문배송조회 > 반품/교환신청 또는 고객센터 (070-4680-5689)로 문의 바랍니다.

[반품주소]

- 도로명 : (10882) 경기도 파주시 산남로 62-20 (산남동)

- 지번 : (10882) 경기도 파주시 산남동 305-21

[반품/교환가능 기간]

변심반품의 경우 수령 후 14일 이내, 상품의 결함 및 계약내용과 다를 경우 문제점 발견 후 30일 이내

[반품/교환비용]

단순 변심 혹은 구매착오로 인한 반품/교환은 반송료 고객 부담

[반품/교환 불가 사유]

- 소비자의 책임 있는 사유로 상품 등이 손실 또는 훼손된 경우

(단지 확인을 위한 포장 훼손은 제외)

- 소비자의 사용, 포장 개봉에 의해 상품 등의 가치가 현저히 감소한 경우

예) 화장품, 식품, 가전제품(악세서리 포함) 등

- 복제가 가능한 상품 등의 포장을 훼손한 경우

예) 음반/DVD/비디오, 소프트웨어, 만화책, 잡지, 영상 화보집

- 소비자의 요청에 따라 개별적으로 주문 제작되는 상품의 경우 ((1)해외주문도서)

- 디지털 컨텐츠인 eBook, 오디오북 등을 1회 이상 다운로드를 받았을 경우

- 시간의 경과에 의해 재판매가 곤란한 정도로 가치가 현저히 감소한 경우

- 전자상거래 등에서의 소비자보호에 관한 법률이 정하는 소비자 청약철회 제한 내용에 해당되는 경우

* (1) 해외주문도서 : 이용자의 요청에 의한 개인주문상품으로 단순변심 및 착오로 인한 취소/교환/반품 시

‘해외주문 반품/취소 수수료’ 고객 부담 (해외주문 반품/취소 수수료 : ①양서-판매정가의 12%, ②일서-판매정가의 7%를 적용)

[상품 품절]

공급사(출판사) 재고 사정에 의해 품절/지연될 수 있으며, 품절 시 관련 사항에 대해서는 이메일과 문자로 안내드리겠습니다.

[소비자 피해보상, 환불지연에 따른 배상]

- 상품의 불량에 의한 교환, A/S, 환불, 품질보증 및 피해보상 등에 관한 사항은 소비자분쟁해결 기준 (공정거래위원회 고시)에 준하여 처리됩니다.

- 대금 환불 및 환불지연에 따른 배상금 지급 조건, 절차 등은 전자상거래 등에서의 소비자 보호에 관한 법률에 따라 처리함.

![내 영혼이 따뜻했던 날들 [ 양장 ]](http://211.169.249.153/data/item/9788955824957/thumb-9788955824957_60x60.jpg)